El 16 de mayo, Facebook anunció que había eliminado un conjunto de 265 activos de Facebook e Instagram, entre los que se encontraban cuentas, páginas, grupos y eventos que participaban en comportamientos inauténticos coordinados en la Plataforma.

Según la empresa de redes sociales, algunos de los activos estaban vinculados a la empresa israelí de marketing político Archimedes Group y se dirigían a audiencias de todo el mundo, con énfasis en África, América Latina y el sudeste asiático. Las tácticas empleadas por Archimedes Group, una empresa privada, se parecen mucho a los tipos de tácticas de guerra de la información que suelen utilizar los gobiernos, y el Kremlin en particular. Sin embargo, a diferencia de las campañas de información dirigidas por el gobierno, el DFRLab no pudo identificar ningún tema ideológico en las páginas eliminadas, lo que indica que las actividades tenían fines de lucro.

Archimedes Group es una empresa israelí de marketing político que afirma realizar “campañas ganadoras en todo el mundo,” lo que indica el alcance político y global de sus actividades. La empresa lleva a cabo sus operaciones utilizando su producto Archimedes Tarva, que, según una descripción en línea, incluye “herramientas de gestión y automatización de campañas masivas en medios sociales, creación de plataformas a gran escala y funcionamiento de cuentas online ilimitadas”.

Facebook alertó al DFRLab de un subconjunto de activos poco antes de la retirada. Una investigación inicial descubrió que muchos de ellos publicaban contenido político para impulsar o atacar a los políticos locales. Para ello, se creaban páginas que apoyaban o atacaban a un político, se hacían pasar por organizaciones de noticias o de comprobación de hechos, y se creaban páginas diseñadas para proporcionar “filtraciones” sobre un determinado candidato.

Los activos mostraban signos de falta de autenticidad: algunos pretendían ser de un país, pero cometían errores flagrantes en sus publicaciones respecto a la realidad sobre el terreno, mientras que otros eran gestionados desde fuera de su país objetivo. Probablemente debido a su algoritmo, Facebook también identificó páginas del grupo como “páginas relacionadas” cuando no había similitudes evidentes en cuanto a la ubicación o al tema, lo que sugería que podían formar parte de la misma red.

La red tenía como objetivo al menos 13 países y era seguida por más de 2,8 millones de usuarios. Sin embargo, es difícil determinar el éxito de la operación, ya que es difícil saber si las cuentas que participaron en estos activos eran falsas o auténticas. Independientemente del alcance de los activos, el hecho de que fueran operadas por una empresa con fines de lucro es una señal preocupante de que la desinformación altamente partidista se está convirtiendo en una empresa de capital.

Apuntando a las Elecciones Nigerianas de 2019

Muchas de las páginas incluidas en este desmontaje se centraron en las elecciones nigerianas de febrero de 2019 que vieron a Muhammadu Buhari reelegido como presidente del país.

Una de las páginas retiradas, “Empeoremos Nuevamente a Nigeria”, parecía ser una campaña de trolling dirigida a Atiku Abubakar, ex vicepresidente de Nigeria y principal oponente de Buhari. La página incluía una imagen de Abubakar como Darth Vader, el famoso villano de Star Wars.

El DFRLab también encontró una página muy similar, “El Equipo Atiku para Presidente”, cuyo objetivo era reforzar el apoyo a la campaña presidencial de Abubakar. No está claro por qué la red tenía una operación a favor y otra en contra de Abubakar, pero la página de apoyo probablemente estaba diseñada para identificar a sus partidarios con el fin de dirigirse a ellos con contenido anti-Abubakar más tarde, posiblemente desviándolos a la página “Empeoremos Nuevamente a Nigeria”

Yuxtaposición de las imágenes de los carteles de Facebook de las páginas a favor y en contra de Abubakar. (Fuente: El Equipo Atiku para Presidente/archivo, arriba; Empeoremos Nuevamente Nigeria/archivo, abajo)

Yuxtaposición de las imágenes de los carteles de Facebook de las páginas a favor y en contra de Abubakar. (Fuente: El Equipo Atiku para Presidente/archivo, arriba; Empeoremos Nuevamente Nigeria/archivo, abajo)

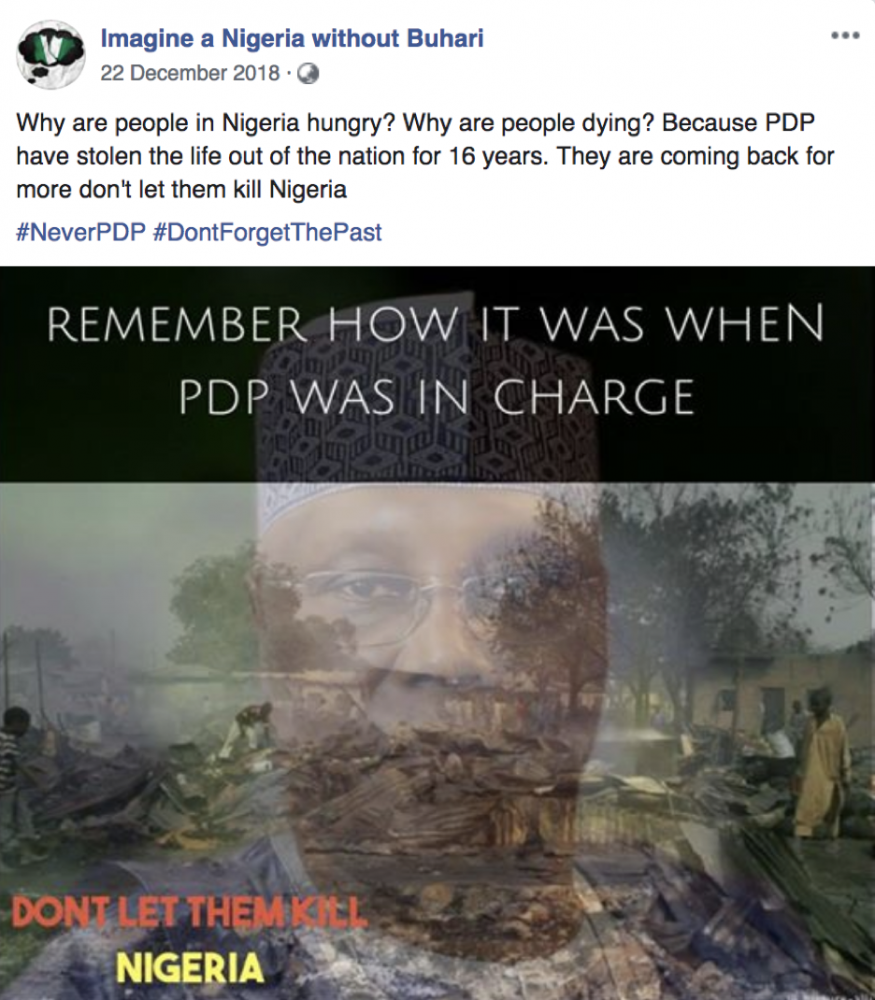

Otra página, “Imaginemos a una Nigeria sin Buhari”, pretendía reforzar el apoyo a la candidatura de Buhari. Algunos de los posts elogiaban hipotéticamente el mandato presidencial de Buhari como si no hubiera sido reelegido, para convencer a los votantes de sus logros.

Un vídeo subido por una página nigeriana que pretendía recabar apoyos para la candidatura de Buhari elogiando su presidencia, a pesar de que aún no se habían celebrado las elecciones. (Fuente: Imaginemos a una Nigeria sin Buhari/archivo)

Un vídeo subido por una página nigeriana que pretendía recabar apoyos para la candidatura de Buhari elogiando su presidencia, a pesar de que aún no se habían celebrado las elecciones. (Fuente: Imaginemos a una Nigeria sin Buhari/archivo)

Otro falso post de elogio de la misma página, esta vez insinuando que el partido PDP de Abubakar “mataría a Nigeria”. (Fuente: Imaginemos a una Nigeria sin Buhari/archivo)

Otro falso post de elogio de la misma página, esta vez insinuando que el partido PDP de Abubakar “mataría a Nigeria”. (Fuente: Imaginemos a una Nigeria sin Buhari/archivo)

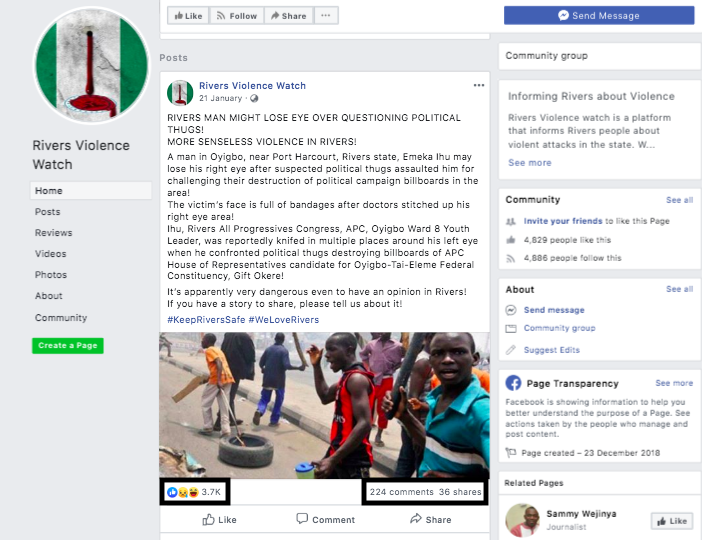

Otro grupo de páginas se centró en las turbulentas elecciones locales del estado nigeriano de Rivers. Las elecciones se celebraron en marzo, pero el anuncio de los resultados se pospuso hasta abril debido a la violencia generalizada en la región. Varias de las páginas eliminadas apuntaban a Ezenwo Nyesom Wike, quien se presentaba a un segundo mandato como gobernador como miembro del Partido Democrático Popular (PDP), al que también pertenece Abubakar, mientras que otras apoyaban a su oponente Tonye Cole, del partido All Progressives Congress (APC).

La página “Vigilancia de la Violencia en Rivers” se describía a sí misma como “una plataforma para informar sobre incidentes de violencia en el estado de Rivers”, pero sin embargo mostraba un fuerte sesgo anti-Wike y pro-APC, lo que sugiere que podría haber sido parte de la misma campaña contra Wike. Las publicaciones de esta página tenían un porcentaje extremadamente alto de “me gusta” en comparación con los comentarios y las acciones, un indicador de la actividad automatizada.

Un post de la cuenta “Vigilancia de la Violencia en Rivers” - nótese la gran discrepancia entre el número de reacciones (en el recuadro negro de la parte inferior izquierda) y el número de comentarios y compartidos (en el recuadro negro de la parte inferior central). (Fuente: Rivers Violence Watch)

Un post de la cuenta “Vigilancia de la Violencia en Rivers” - nótese la gran discrepancia entre el número de reacciones (en el recuadro negro de la parte inferior izquierda) y el número de comentarios y compartidos (en el recuadro negro de la parte inferior central). (Fuente: Rivers Violence Watch)

Falso Falsos Cazadores Pillados

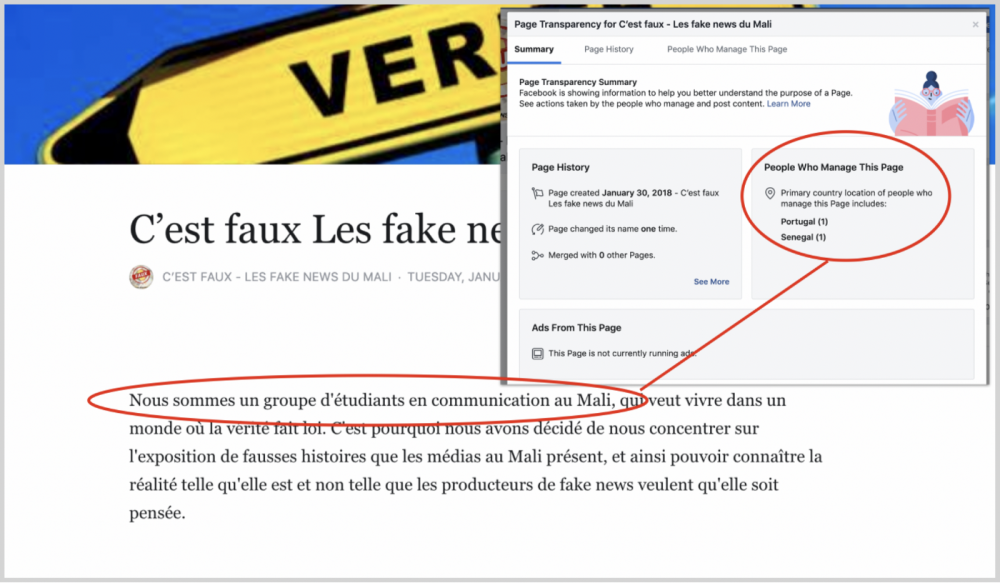

Algunas de las páginas eliminadas se hacían pasar por vigilantes de la desinformación, afirmando que exponían “noticias falsas” en los países a los que se dirigían. Por ejemplo, “C’est faux - les fake news du Mali” (“Es falso - las noticias falsas de Malí”) afirmaba exponer “las historias falsas que presentan los medios de comunicación de Malí.” Se creó en enero de 2018 y se publicó hasta finales de mayo de ese mismo año.

La mayor parte de sus posts informaban sobre denuncias de “noticias falsas” relacionadas con África o dirigidas a los africanos. Su sección “Acerca de” decía que había sido fundada por estudiantes de comunicación de Malí. Sin embargo, la función “Transparencia” de Facebook confirmó que, en realidad, estaba dirigida por gestores de Senegal y Portugal.

¿Quién es falso ahora? Secciones “Acerca de” (fondo) y “Transparencia de la página” (primer plano) de la página “C'est faux - les fake news du Mali”. La sección “Acerca de” comienza así: “Somos un grupo de estudiantes de comunicación de Malí”, pero la sección “Transparencia de la página” muestra que la página se dirigía desde Portugal y Senegal. (Fuente: C’est faux - les fake news du Mali)

¿Quién es falso ahora? Secciones “Acerca de” (fondo) y “Transparencia de la página” (primer plano) de la página “C'est faux - les fake news du Mali”. La sección “Acerca de” comienza así: “Somos un grupo de estudiantes de comunicación de Malí”, pero la sección “Transparencia de la página” muestra que la página se dirigía desde Portugal y Senegal. (Fuente: C’est faux - les fake news du Mali)

Por lo tanto, parece probable que el enfoque en las historias falsas haya sido una fachada, diseñada para construir una reputación de credibilidad antes de ejecutar operaciones de información. No estaba claro por qué la página dejó de publicar en 2018.

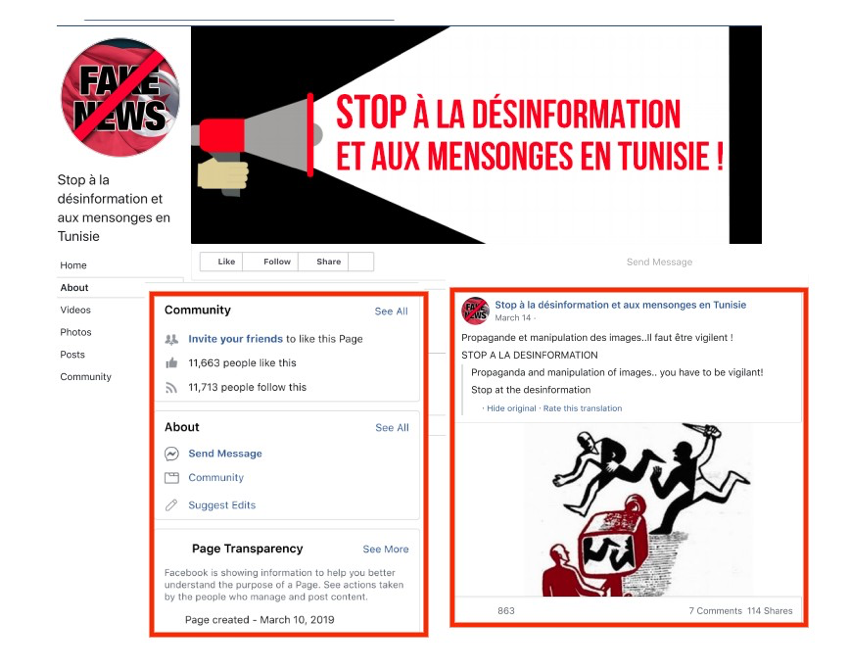

Otra página eliminada por Facebook, “Stop à la désinformation et aux mensonges” (“Alto a la desinformación y a las mentiras”), se hacía pasar por un grupo de vigilancia de los medios de comunicación para combatir la desinformación en Túnez. Irónicamente, se centraba en denunciar lo que decía ser desinformación en los medios de comunicación tunecinos, exigiendo que los tunecinos estuvieran más atentos, a pesar de ser una campaña de desinformación inauténtica en sí misma.

La imagen de pantalla de la página “Stop à la désinformation et aux mensonges” muestra que la página fue creada en marzo de 2019 y rápidamente acumuló más de 11.000 seguidores (izquierda). A la derecha, un post aconseja a la gente estar atenta a la propaganda y la manipulación. (Fuente: Stop à la désinformation et aux mensonges)

La imagen de pantalla de la página “Stop à la désinformation et aux mensonges” muestra que la página fue creada en marzo de 2019 y rápidamente acumuló más de 11.000 seguidores (izquierda). A la derecha, un post aconseja a la gente estar atenta a la propaganda y la manipulación. (Fuente: Stop à la désinformation et aux mensonges)

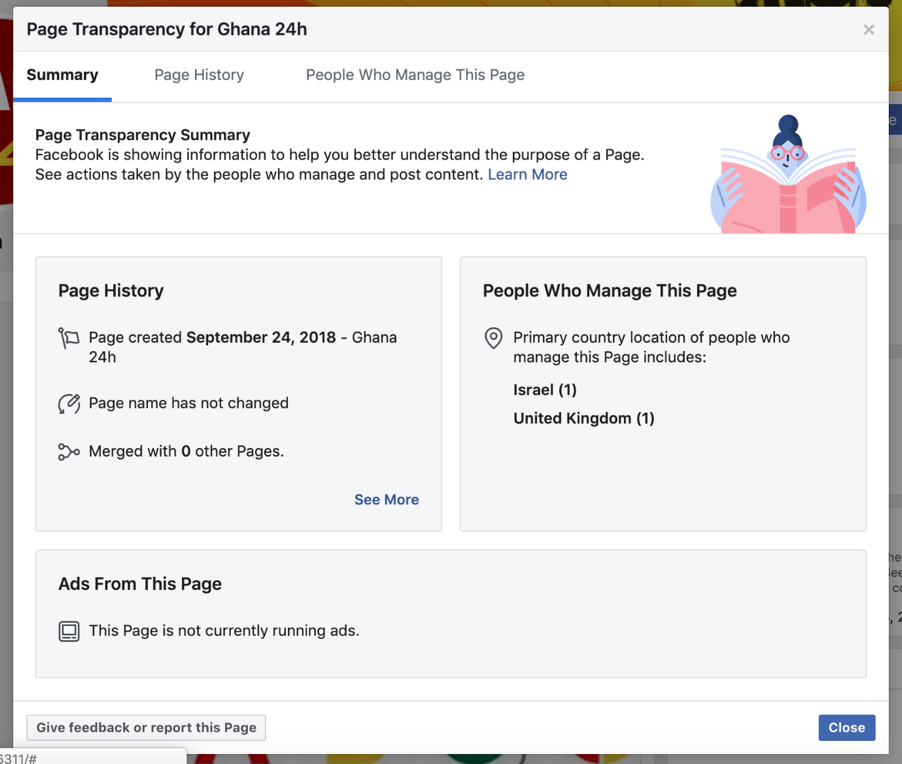

Otras páginas eliminadas por Facebook afirmaban ser medios de comunicación. La página Ghana 24, por ejemplo, se presentaba como un sitio de noticias, pero amplificaba historias y noticias progubernamentales. Aunque la página era sobre Ghana, estaba gestionada por un usuario de Israel y otro del Reino Unido.

Muchos usuarios denunciaron estas supuestas “organizaciones mediáticas” en sus comentarios y reseñas de las páginas, afirmando que estaban difundiendo “noticias falsas” y desinformación. Al escribir una reseña sobre “La Gaceta de Garden City”, que también se centraba en el estado nigeriano de Rivers, los usuarios dijeron que la página estaba “creando confusión” y “vendiendo noticias falsas”. Los comentarios aparecieron sobre todo en febrero y marzo, al menos dos meses antes de que la página fuera retirada por Facebook.

La imágen de pantalla muestra las críticas de los usuarios a la página “La Gazeta de Garden City”. Dos usuarios dijeron que el contenido era falso y pretendía crear confusión. (Fuente: La Gazeta de Garden City)

La imágen de pantalla muestra las críticas de los usuarios a la página “La Gazeta de Garden City”. Dos usuarios dijeron que el contenido era falso y pretendía crear confusión. (Fuente: La Gazeta de Garden City)

Páginas de “Filtro”

Algunas páginas del grupo prometían entregar “contenidos filtrados” que podrían ser utilizados como arma contra un candidato o en apoyo de una causa. La página “L’Afrique Cachée”, por ejemplo, se describía a sí misma como una organización especializada en la “publicación de documentos oficiales censurados o muy restringidos sobre la guerra, el espionaje y la corrupción en África”. La página, sin embargo, publicaba sobre todo artículos de noticias antiguas acompañados de sus propios análisis.

La página de “L’Afrique Cachée”, que pretendía publicar documentos oficiales censurados. (Fuente: L'Afrique Cachée)

La página de “L’Afrique Cachée”, que pretendía publicar documentos oficiales censurados. (Fuente: L'Afrique Cachée)

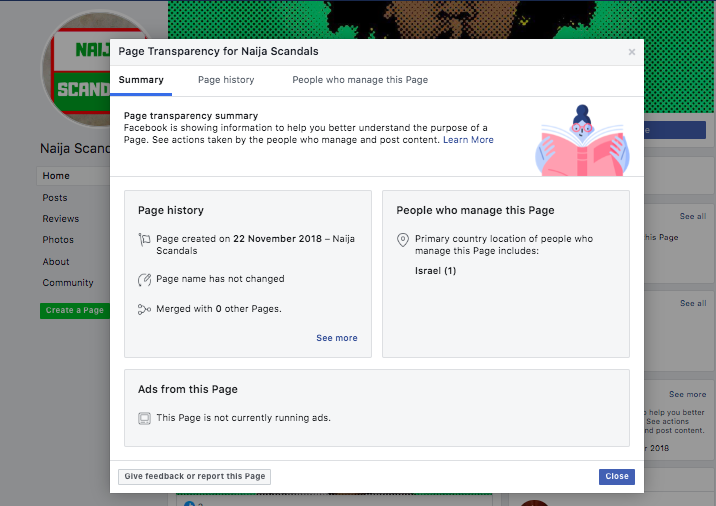

La página “Naija Scandals” (“Escándalos de Nigeria”), con un administrador de la página en Israel, también se describió a sí misma como una página de filtraciones, prometiendo compartir “todas las cosas que no quieren que sepas sobre Naija.” Sin embargo, en el momento en que fue eliminada, esta página no tenía ninguna publicación, sólo fotos de perfil que habían obtenido entre tres y cinco “me gusta”.

“Naija Scandals”, una página aparentemente dedicada a las “cosas que no quieren que sepas”, fue gestionada desde Israel. (Fuente: Naija Scandals)

“Naija Scandals”, una página aparentemente dedicada a las “cosas que no quieren que sepas”, fue gestionada desde Israel. (Fuente: Naija Scandals)

Patriotas del País Equivocado

Algunas de las páginas cometían errores flagrantes que las exponían como probablemente inauténticas, simplemente por el contenido.

Por ejemplo, “Fier d'être Nigérien” (“Orgulloso de ser de Níger”) tenía un tono muy patriótico. La imagen de su bandera mostraba una mezquita, con la leyenda “Le Niger, ma fierté” (“Níger, mi orgullo”); sin embargo, un usuario señaló que la mezquita era en realidad la mezquita de Hassan II en Casablanca, Marruecos, lo que DFRLab confirmó.

Izquierda, la sección de “posts” de Fier d'etre Nigérien, mostrando la mezquita de la bandera y el comentario (en el recuadro rosado) de un usuario que decía: “¿Están realmente orgullosos de Níger...? Si no, ¿por qué publicar la mezquita de Hassan II en Casablanca cuando la nuestra está allí?”. A la derecha, imagen de la mezquita extraída de su página web oficial, con recuadros de colores indicando las coincidencias arquitectónicas. (Fuente: Fier d'etre Nigérien, izquierda; fmh2.ma, derecha)

Izquierda, la sección de “posts” de Fier d'etre Nigérien, mostrando la mezquita de la bandera y el comentario (en el recuadro rosado) de un usuario que decía: “¿Están realmente orgullosos de Níger...? Si no, ¿por qué publicar la mezquita de Hassan II en Casablanca cuando la nuestra está allí?”. A la derecha, imagen de la mezquita extraída de su página web oficial, con recuadros de colores indicando las coincidencias arquitectónicas. (Fuente: Fier d'etre Nigérien, izquierda; fmh2.ma, derecha)

Otra página, “Tunisie Mon amor”, también presentaba imágenes de otros países como si fueran de Túnez. La página promovía el turismo en el país, pero utilizaba imágenes de Marruecos y Turquía en sus posts.

Ubicación, Ubicación, Ubicación

Muchas de las páginas centradas en países africanos concretos y que decían ser gestionadas por alguien de esos países, en realidad lo eran desde otros lugares. Por ejemplo, la página “Ghana 24h” pretendía ser un sitio de noticias de Ghana, pero estaba gestionada por cuentas de Israel y el Reino Unido.

Imagen de pantalla de la sección de “transparencia de la página” de “Ghana 24h”, en la que se muestra que la ubicación de sus gestores es Israel y el Reino Unido. (Fuente: Ghana 24h)

Imagen de pantalla de la sección de “transparencia de la página” de “Ghana 24h”, en la que se muestra que la ubicación de sus gestores es Israel y el Reino Unido. (Fuente: Ghana 24h)

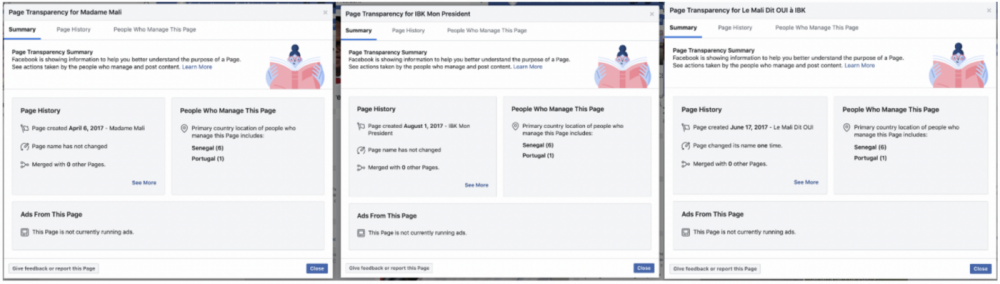

Muchas de las páginas que se centraban en Malí, por su parte, estaban de hecho dirigidas por seis gestores en Senegal y un gestor en Portugal, lo que sugiere que había un equipo regional específico detrás de ellas. Casi todas estas páginas apoyaban al presidente maliense Ibrahim Boubacar Keïta, incluyendo páginas con nombres que se traducían como “IBK, mi presidente” y “Mali dice ‘Sí’ a IBK.”

Imágen de pantalla de la sección “transparencia de la página” de Madame Mali, IBK Mon Président y Le Mali dit Oui à IBK, en la que se muestran las ubicaciones de los gestores, con seis en Senegal y uno en Portugal. (Fuente: Madame Mali, izquierda; IBK Mon Président, centro; Le Mali Dit Oui à IBK, derecha)

Imágen de pantalla de la sección “transparencia de la página” de Madame Mali, IBK Mon Président y Le Mali dit Oui à IBK, en la que se muestran las ubicaciones de los gestores, con seis en Senegal y uno en Portugal. (Fuente: Madame Mali, izquierda; IBK Mon Président, centro; Le Mali Dit Oui à IBK, derecha)

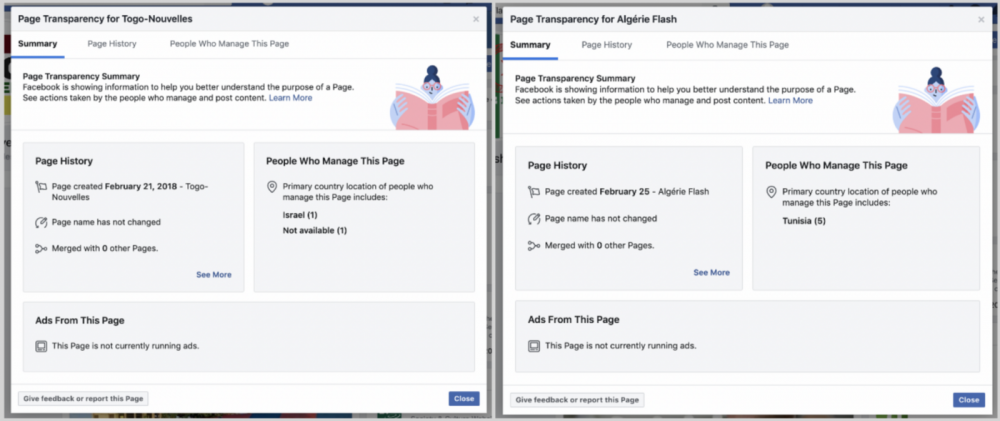

En la misma línea, la página “Algérie-Flash” (Argelia-Flash) se gestionaba desde Túnez, mientras que “Togo-Nouvelles” (Togo-Noticias) se dirigía desde Israel y un lugar desconocido.

Imagen de pantalla de la función “transparencia de la página” para Togo-Nouvelles y Algérie Flash, mostrando las ubicaciones de los gestores. (Fuente: Togo-Nouvelles, izquierda; Algérie Flash, derecha)

Imagen de pantalla de la función “transparencia de la página” para Togo-Nouvelles y Algérie Flash, mostrando las ubicaciones de los gestores. (Fuente: Togo-Nouvelles, izquierda; Algérie Flash, derecha)

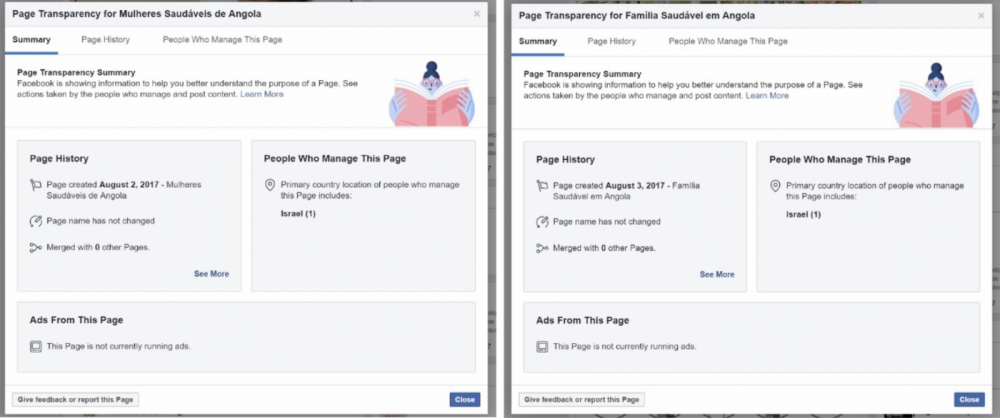

Asimismo, desde Israel se gestionaron dos páginas dedicadas a temas de salud en Angola, denominadas “Mulheres Saudáveis de Angola” (“Mujeres sanas de Angola”) y “Família Saudável em Angola” (“Familia sana en Angola”) fueron administradas desde Israel.

Imágen de pantalla de la sección “transparencia de la página”, con los gestores que figuran como ubicados en Israel, para “Mulheres Saudáveis de Angola” y “Família Saudável em Angola”. (Fuente: Mulheres Saudáveis de Angola, izquierda; Família Saudável em Angola, derecha)

Imágen de pantalla de la sección “transparencia de la página”, con los gestores que figuran como ubicados en Israel, para “Mulheres Saudáveis de Angola” y “Família Saudável em Angola”. (Fuente: Mulheres Saudáveis de Angola, izquierda; Família Saudável em Angola, derecha)

Relacionados, pero No Tanto

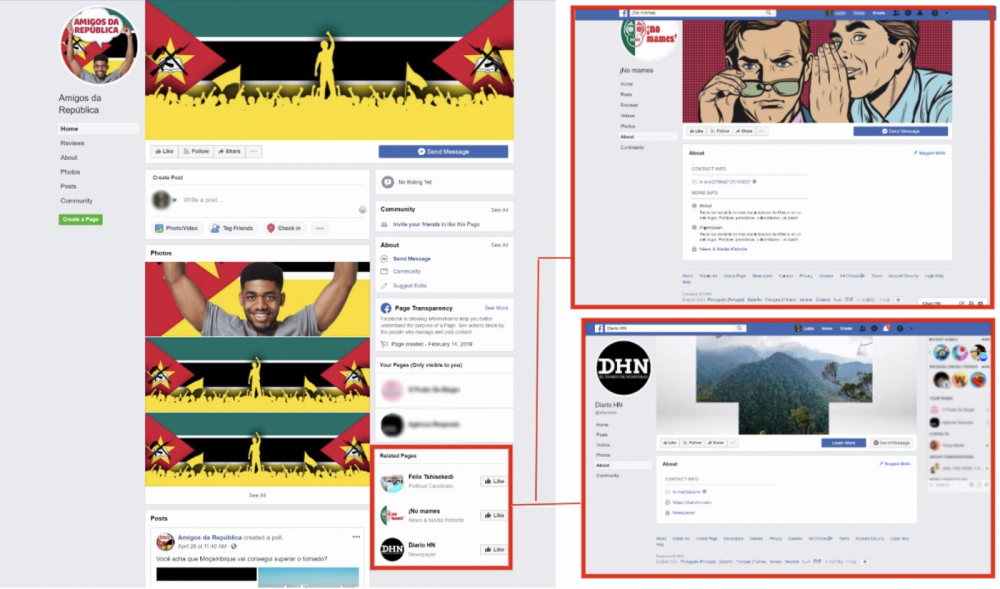

La sección “páginas relacionadas” de algunos de los activos eliminados sugería que las páginas formaban parte de la misma red. La sección “páginas relacionadas” es generada por el algoritmo de Facebook. Aunque no se conoce la mecánica exacta del algoritmo, se cree que se basa en el comportamiento y las relaciones de las cuentas que les gustan, siguen e interactúan con las páginas en cuestión. El hecho de que Facebook sugiriera otras páginas del conjunto eliminado como páginas relacionadas, indica que el algoritmo reconoció una relación entre las cuentas.

El ejemplo más ilustrativo de esto fue la página comunitaria “Amigos da República” (“Amigos de la República”), que era aparentemente de Mozambique. En su sección de páginas relacionadas, Facebook recomendó tanto “No Mames”, una página centrada en México, como “DHN”, centrada en Honduras. Las páginas no están en el mismo idioma, no se dirigen al mismo continente y no tratan del mismo tema. La única relación que se conoce entre ellas es que todas fueron finalmente eliminadas por Facebook en este desmontaje.

Imágenes de pantalla de las páginas relacionadas con “Amigos da República” apuntando hacia DHN y No Mames. (Fuentes: Amigos da República, izquierda; No Mames, arriba a la derecha; DHN, abajo a la derecha)

Imágenes de pantalla de las páginas relacionadas con “Amigos da República” apuntando hacia DHN y No Mames. (Fuentes: Amigos da República, izquierda; No Mames, arriba a la derecha; DHN, abajo a la derecha)

Alcance y Eficacia

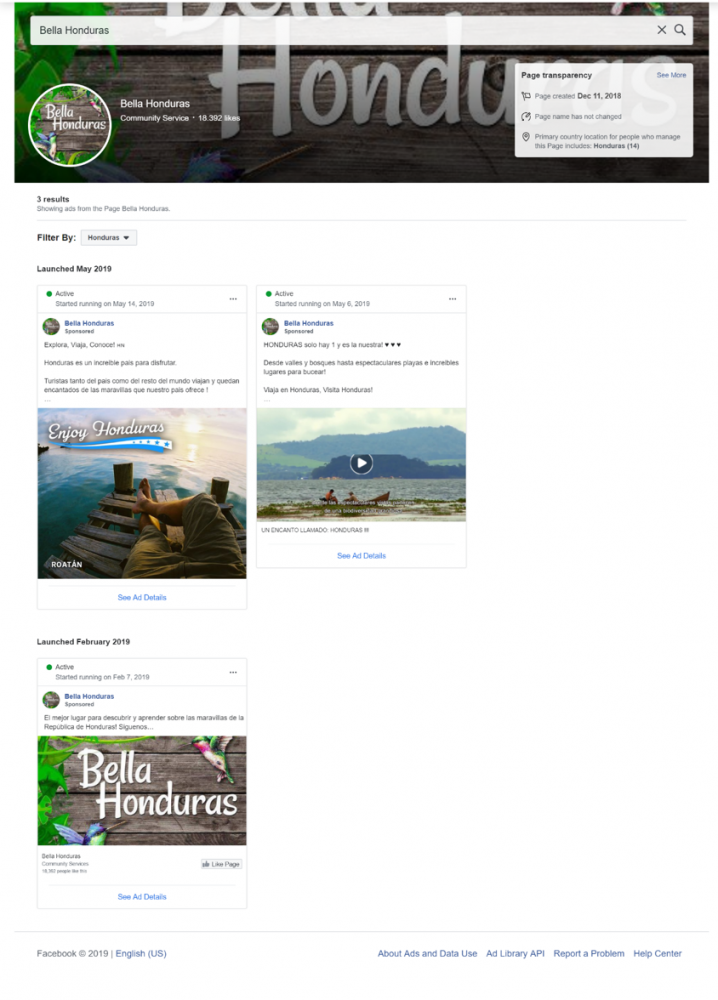

La red de páginas eliminadas por Facebook gastó unos 812.000 dólares en gastos publicitarios pagados en reales brasileños, shekels israelíes y dólares estadounidenses, según el comunicado de Facebook. El gasto en diferentes monedas sugiere la amplitud de la operación, que abarcaba múltiples regiones del mundo.

Anuncios de la página Bella Honduras que promocionan el turismo en el país. La imagen de pantalla muestra que el último anuncio comenzó a circular el 14 de mayo. (Fuente: Bella Honduras)

Anuncios de la página Bella Honduras que promocionan el turismo en el país. La imagen de pantalla muestra que el último anuncio comenzó a circular el 14 de mayo. (Fuente: Bella Honduras)

El DFRLab analizó la página con mayor número de seguidores, “Peuple du Mali”, dedicada a la política local de Malí, y descubrió que tenía muchos me gusta en comparación con los comentarios. Cuando este tipo de discrepancia se reparte entre muchas publicaciones, la interacción debe considerarse sospechosa.

Gráfico que muestra los me gusta (en naranja) frente a los comentarios (en azul) de la página de Facebook “Peuple du Mali”. Obsérvese el bajo volumen casi constante de comentarios y el volumen mucho mayor de me gusta. (Fuente: @KaranKanishk/DFRLab)

Gráfico que muestra los me gusta (en naranja) frente a los comentarios (en azul) de la página de Facebook “Peuple du Mali”. Obsérvese el bajo volumen casi constante de comentarios y el volumen mucho mayor de me gusta. (Fuente: @KaranKanishk/DFRLab)

No está claro si otras páginas también tenían participación inorgánica, pero el comunicado de Facebook destaca que muchas de las cuentas se consideraron inauténticas debido a la participación inflada y manipulada.

Luiza Bandeira es Asistente de Investigación Forense Digital para América Latina en el Digital Forensic Research Lab (@DFRLab).

Andy Carvin es Investigador Principal en @DFRLab.

Kanishk Karan es Investigador Asistente en @DFRLab.

Mohamed Kassab es Asistente de Investigación Forense Digital de @DFRLab con sede en el Cairo.

Ayushman Kaul es Asistente de Investigación, Sur de Asia, para @DFRLab.

Ben Nimmo es Investigador Principal para la Defensa de la Información en @DFRLab.

Michael Sheldon es Investigador Forense Digital Asociado en @DFRLab.

Ilustración de fondo: @KaranKanishk/DFRLab

El artículo fue publicado originalmente en el sitio web de DFRLab (17.03.2019).